栏目索引

相关内容

基于时间碎片化、视频交互强、内容丰富、体验好等因素,短视频近几年处在流量风暴的中心,各大平台纷纷涉足短视频领域。因此,平台对短视频内容的推荐尤为重要,千人千面是短视频推荐核心竞争力。短视频一般从“点击率”与“观看时长”两方面优化来提升用户消费时长。

接下来,UC事业部国际研发团队的童鞋,将从这两方面重点论述短视频模型点击时长多目标优化。

背景

目前,信息流短视频排序是基于CTR预估Wide&Deep深层模型。在Wide&Deep模型基础上做一系列相关优化,包括相关性与体感信号引入、多场景样本融合、多模态学习、树模型等,均取得不错收益。

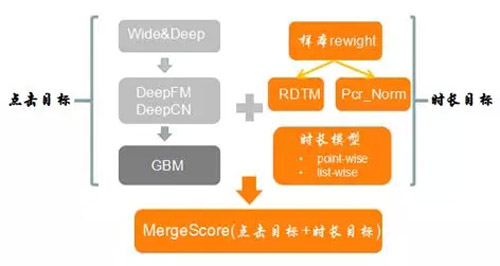

总体上,短视频模型优化可分为两部分优化:

感知相关性优化——点击模型以优化(CTR/Click为目标)

真实相关性优化——时长多目标优化(停留时长RDTM/播放完成率PCR)

上述收益均基于点击模型的优化,模型能够很好地捕抓USER-ITEM之间感知相关性,感知权重占比较高,弱化真实相关性,这样可能导致用户兴趣收窄,长尾问题加剧。此外,观看时长,无论是信息流、竞品均作为重要优化目标。在此背景下,短视频排序模型迫切需要引入时长多目标优化,提升推荐的真实相关性,寻求在时长上取得突破。

时长多目标的引入,排序模型不仅仅优化点击目标,同时也要兼顾时长目标,使得排序模型的感知相关性与真实相关性之间取得收益最大化的平衡;目前业界点击+时长目标优化有多种方式,包括多模态学习(点击+时长)、联合建模、样本reweight等。

本次我们使用样本reweight方法,在点击label不变的前提下,时长作为较强的bias去影响时长目标,保证感知相关性前提,去优化真实相关性。此外,我们正调研更加自适应的时长建模方式(point-wise、list-wise),后续继续介绍。上述是模型时长多目标优化简介,样本reweight取得不错的收益,下面展开介绍下。

RDTM REWEIGHTING

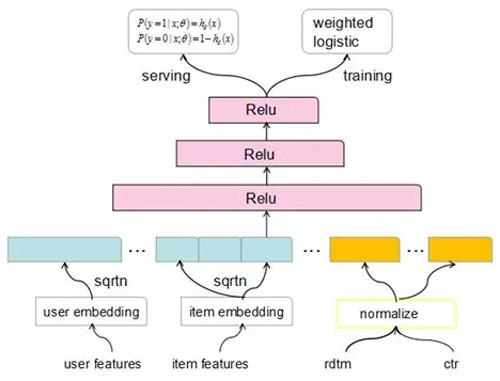

观看时长加权优化,我们使用weightlogistic regression方法,参照RecSys2016上Youtubb时长建模,提出点击模型上样本reweight。模型训练时,通过观看时长对正样本加权,负样本权重不变,去影响正负样本的权重分布,使得观看时长越长的样本,在时长目标下得到充分训练。

加权逻辑回归方法在稀疏点击场景下可以很好使得时长逼近与期望值。假设就是weighted logistic regression学到的期望,其中N是样本数量,K是正样本,Ti是停留时长,真实期望就近似逼近E(T)*(1+P),P是点击概率,E(T)是停留时长期望值,在P<<1情况下,真实期望值就逼近E(T)。因此,加权逻辑回归方式做样本加权,切合我们点击稀疏的场景,通过样本加权方式使得模型学到item在观看时长上偏序关系。

样本加权优化我们参照了Youtube的时长建模,但做法上又存在一些差异:

Label:Youtube以时长为label做优化,而我们还是基于点击label,这样是为了保证模型感知相关性(CTR/Click)。

分类/回归:Youtube以回归问题作时长加权,serving以指数函数拟合时长预测值,我们则是分类问题,优化损失函数logloss,以时长bias优化时长目标。

加权形式:时长加权方式上我们考虑观看时长与视频长短关系,采用多分段函数平滑观看时长和视频长短关系,而youtube则是观看时长加权。

上述差异主要从两个方面考虑:

保证CTR稳定的前提下(模型label依然是点击),通过样本reweight去优化时长目标。

分段函数平滑避免长短视频的下发量严重倾斜,尽可能去减少因为视频长短因素,而使模型打分差距较大问题。

在模型网络结构上,底层类目或内容特征做embedding共享,连续特征离散归一化。训练时通过引入weighted logistic去优化时长目标,在线预测依然是0/1概率,而在0/1概率跟之前不同是的经过时长bias修正,使得模型排序考虑真实相关性。

离线评估指标

1、AUC:AUC作为排序模型常用离线评估特别适用是0/1分类问题,短视频排序模型依然是0/1问题,所以,AUC是一个基础离线指标。此外,AUC很难准确地评估模型对于时长优化好坏,AUC只是作为模型准入的条件,保证AUC持平/正向前提下,我们需要时长指标衡量准确地模型收益。

#p#分页标题#e#2、AVG_RDTM:(预测平均停留时长):每一batch中选取模型打分top k正样本,取该批样本观看时长均值作为AVG_RDTM,AVG_RDTM的大小来离线评估模型在时长推荐的好坏。物理意义: 取打分top k正样本,保证模型推荐感知相关性(CTR)前提下,AVG_RDTM指标衡量点击正样本的观看时长收益,AVG_RDTM越大,时长收益越好。在线时长指标趋势与AVG_RDTM一致,涨幅上有diff。

PCR_NORM REWEIGHTING

一期在观看时长样本加权上取得不错的收益,二期是集中播放完成率上的优化。

二期我们策略review结果发现,目前一大部分高播放完成率的视频,CTR较低,模型打分靠后,这批item中较短视频内占比较大。一期通过时长分段函数样本加权,虽然一定程度上平滑了视频长短对打分影响,但是播放完成率体现用户对item的关注度程度更能反映推荐的真实相关性。短视频观看时长,视频播放完成率上取得突破对于短视频规模化和口碑打造具有强推进剂作用。

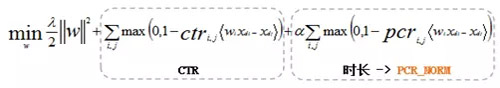

针对以上较短,较长的优质视频打分靠后,下发量不足的问题,我们引入分位数播放完成率来做平滑加权。进一步升级观看时长的优化。主要是以下两种方式:

时长目标优化从停留时长加权演变至播放完成率加权,更好的平滑长短视频之间的打分差异,使得模型打分更加注重于真实相关性。

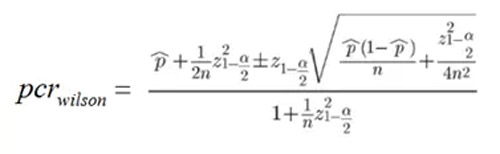

视频时长分段,停留时长完成率分位数归一化+威尔逊置信区间平滑,使得各视频时长段播放完成率相对可比,避免出现打分因视频长度严重倾斜情况。

此外,较短或较长的视频在播放完成率上存在天然的差距,我们按视频本身长度离散,观看时长做分位数处理,在此基础添加威尔逊置信区间。归一化长短视频播放完成率上的差异,使得各长度段的视频播放完成率处在可比区间内。

时长多目标优化从观看时长(RDTM)升级至播放完成率(PCR_Norm), 使得短视频观看时长处在相对可比的状态,尽可能减少视频长短对打分影响,使得模型打分更加专注于User-Item真实相关性与视频质量,提升长尾优质的视频消费,拉升整体视频观看时长。

二期Pcr_norm优化在一期观看时长优化基础上,离线评估AUC与AVG_RDTM,归一化播放完成率更能反映用户对视频的专注度,通过优化视频单次阅读时长,阅读完成率来提升整体的观看时长的消费。

优化收益:

一期+二期离线AUC累积提升6%以上,在线人均时长累积提升10%以上。

结语

信息流短视频多目标优化目前处于探索阶段,初步探索出短视频多目标优化渐进路线,从样本reweight -> point-wise/list-wise时长建模 -> 多模态联合学习的方向。此外,沉淀了套策略review和数据分析方法论,为后续时长优化提供数据基础。

虽然现阶段短视频时长多目标优化取得不错收益,但是规则性较多,后续我们将逐步转向自适应的时长建模,从point-wise到全局list-wise时长优化,由感知相关性优化转向真实相关性优化,力争在消费时长取得重大突破。自适应点击目标与时长目标的权衡收益最大化,将是我们面临一大挑战。

【本文为51CTO专栏作者“阿里巴巴官方技术”原创稿件,转载请联系原作者】

戳这里,看该作者更多好文

【编辑推荐】

《CTO说》第六期:参加技术大会有没有价值

一文解读合成数据在机器学习技术下的表现

收藏 | 这可能是目前最全的Redis高可用技术解决方案

区块链技术在数字油田的应用构想

从职场小白成长为技术Leader,我“摸爬滚打”的这8年......